AI-Powered Cybersecurity: ความมั่นคงปลอดภัยใหม่ในยุคที่ AI เป็นทั้งโครงสร้างหลักและพื้นที่เสี่ยงขององค์กร

เมื่อ AI นำมาทั้งโอกาสและความเสี่ยง องค์กรจำเป็นต้องยกระดับความมั่นคงปลอดภัยเพื่อรับมือภัยคุกคามที่พัฒนาเร็วกว่าที่เคย

โลกกำลังก้าวเข้าสู่ยุคที่ AI แทรกซึมอยู่ในทุกกระบวนการทางธุรกิจ และภัยคุกคามสามารถเจาะลึกเข้าไปถึง “ข้อมูล–โมเดลปัญญาประดิษฐ์–ห่วงโซ่อุปทานของ AI” ส่งผลกระทบรุนแรงและขยายวงได้เร็วกว่าที่เคย ความเปลี่ยนแปลงนี้กดดันให้องค์กรต้องยกระดับความมั่นคงปลอดภัยในทุกระดับชั้น ครอบคลุมตั้งแต่ข้อมูลไปจนถึงการกำกับดูแลและขีดความสามารถในการฟื้นตัวหลังเกิดเหตุการณ์ เพื่อรับมือกับภัยคุกคามโดยเฉพาะจาก AI ที่ซับซ้อน รวดเร็วและจำนวนมหาศาล

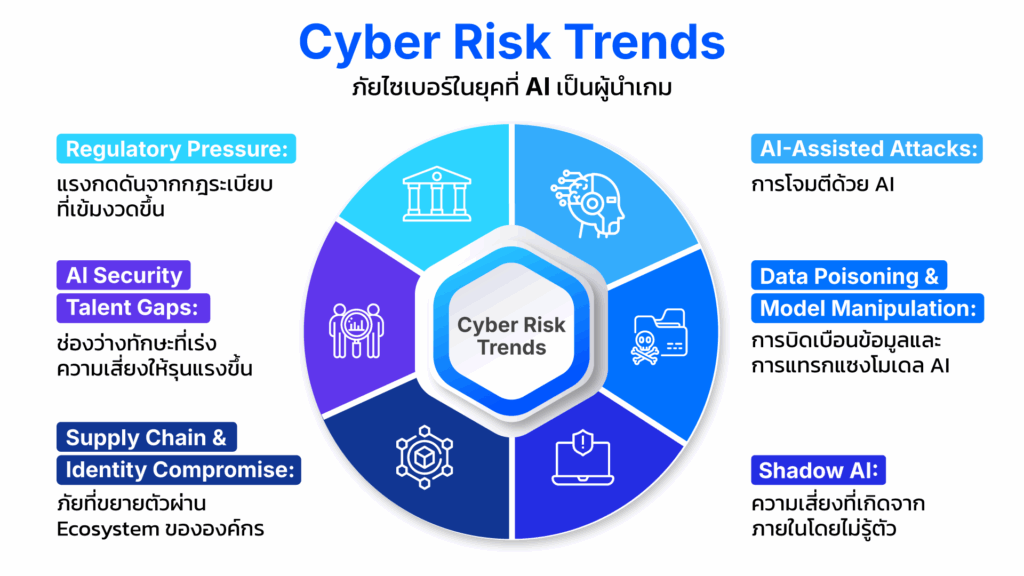

การเปลี่ยนแปลงเชิงโครงสร้างนี้ทำให้ “รูปแบบของการจัดการความเสี่ยง” เปลี่ยนไปโดยสิ้นเชิง จากภัยที่เคยจำกัดอยู่ในระบบไอที กลายเป็นความเสียหายที่อาจกระจายตัวไปทั่วทั้งระบบนิเวศขององค์กร ความสามารถของการโจมตีด้วย AI ที่ทั้งแม่นยำและขยายผลได้เร็ว ทำให้องค์กรและประชาชนต้องเข้าใจรูปแบบภัยคุกคามไซเบอร์ใหม่ ๆ — และนี่คือ Cyber Risk Trends ที่กำลังกำหนดทิศทางของความมั่นคงปลอดภัยในยุคที่ AI เป็นผู้นำเกม

Cyber Risk Trends: ภัยไซเบอร์ในยุคที่ AI เป็นผู้นำเกม

ความท้าทายในยุค AI ทำให้องค์กรไม่สามารถใช้กรอบแนวคิดหรือมาตรฐานเดิม ๆ ในการ ประเมินขีดความสามารถด้านความมั่นคงปลอดภัยอีกต่อไป ซึ่งกระแสสำคัญที่กำลังเป็นแรงกดดันองค์กรต้องคิดใหม่ทำใหม่ทั้ง (ระบบ) หมด มีดังต่อไปนี้:

- Regulatory Pressure: แรงกดดันจากกฎระเบียบที่เข้มงวดขึ้น

รัฐบาลทั่วโลกกำลังกำหนดกติกาด้าน AI Governance, ความโปร่งใสและความรับผิดชอบอย่างเข้มงวดมากขึ้น องค์กรที่ปรับตัล่าช้าอาจเผชิญความเสี่ยงทั้งด้านการดำเนินงานและภาพลักษณ์อย่างหลีกเลี่ยงไม่ได้

- AI Security Talent Gaps: ช่องว่างทักษะที่เร่งความเสี่ยงให้รุนแรงขึ้น

ทีมงานด้านความมั่นคงปลอดภัยไซเบอร์ (Cybersecurity) ที่มีอยู่ขาดความเชี่ยวชาญที่เกี่ยวข้องกับความปลอดภัยของระบบ AI การตรวจสอบพฤติกรรมของโมเดล และการตรวจจับการโจมตีแบบ Adversarial ส่งผลให้เกิดช่องว่างด้านทักษะ องค์กรไม่สามารถพัฒนาหรือว่าจ้างบุคลากรที่มีความสามารถเฉพาะด้านได้ทันกับความเสี่ยงที่ขยายตัวอย่างรวดเร็ว

- Supply Chain & Identity Compromise: ภัยที่ขยายผ่าน Ecosystem ขององค์กร

การโจมตีผ่านซัพพลายเชนและการปลอมแปลงตัวตนยังคงเป็นเส้นทางโจมตีหลัก — และสร้างความเสียหายรุนแรงขึ้นจากความสามารถของ AI ในการลอกเลียนพฤติกรรมและสร้างตัวตนปลอมได้อย่างแนบเนียนและน่าเชื่อถือ

- AI-assisted Attacks: การโจมตีด้วย AI

อาชญากรไซเบอร์ใช้ Generative AI เป็นเครื่องมือโจมตีที่ทั้งรวดเร็วและซับซ้อนขึ้น เพื่อสร้าง Phishing อัตโนมัติ ไปจนถึงพัฒนามัลแวร์และการใช้ Deepfake หลอกลวงทางสังคมอย่างแนบเนียน

- Data Poisoning & Model Manipulation: การบิดเบือนข้อมูลและการแทรกแซงโมเดล AI

ผู้ไม่ประสงค์ดีกำลังมุ่งเป้าไปที่ข้อมูลฝึกสอนหรือเจาะกระบวนการ Inference ของระบบ AI ทำให้โมเดลตัดสินใจผิดพลาด หรือดึงข้อมูลสำคัญออกจากระบบ

- Shadow AI: ความเสี่ยงที่เกิดจากภายในโดยไม่รู้ตัว

หลายองค์กรนำเครื่องมือ AI มาใช้โดยไม่รู้ว่าระบบเหล่านี้สร้างการพึ่งพาใหม่ ๆ และเปิดการเชื่อมต่อผ่าน API ที่ไม่ได้รับการตรวจสอบ ซึ่งกลายเป็นช่องโหว่ด้านความมั่นคงปลอดภัยโดยไม่รู้ตัว

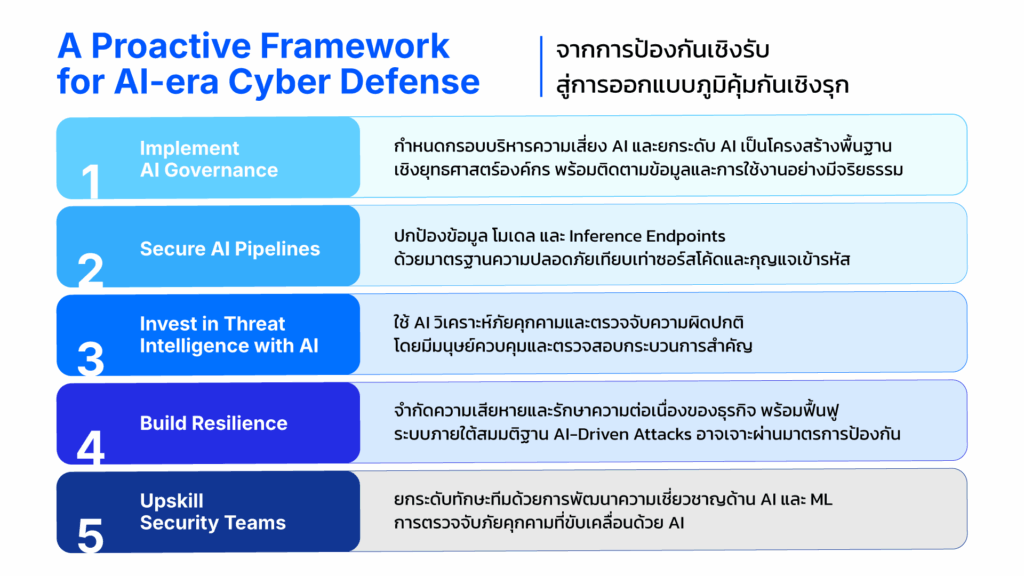

A Proactive Framework for AI-era Cyber Defense: จากการป้องกันเชิงรับ สู่การออกแบบภูมิคุ้มกันเชิงรุก

เมื่อภัยไซเบอร์ที่ขับเคลื่อนด้วย AI สร้างความเสียหายและขยายขอบเขตการโจมตีอย่างรวดเร็ว เกินกว่าที่ระบบป้องกันแบบเดิมจะรับมือได้ องค์กรจึงไม่สามารถรอให้เหตุการณ์เกิดขึ้นแล้วค่อยตอบสนอง การโจมตีที่ใช้ AI สามารถเลียนแบบพฤติกรรมมนุษย์ บิดเบือนข้อมูลฝึกสอน เจาะโมเดล AI หรือแทรกแซงห่วงโซ่อุปทานได้ภายในไม่กี่วินาที ทำให้ระบบความมั่นคงปลอดภัยไซเบอร์จำเป็นต้องยกระดับจาก “การป้องกันเชิงรับ (Reactive)” สู่ “การออกแบบภูมิคุ้มกันเชิงรุก (Proactive)” อย่างเต็มรูปแบบ

กรอบการทำงานเชิงรุกนี้ประกอบด้วย 5 องค์ประกอบสำคัญ ที่เชื่อมโยงข้อมูล โมเดล และการบริหารความเสี่ยงของ AI เข้าด้วยกันอย่างเป็นระบบ ดังนี้:

- Implement AI Governance: กำหนดกรอบการบริหารความเสี่ยงของโมเดล ติดตามเส้นทางข้อมูล และกำกับการใช้ AI อย่างมีจริยธรรม พร้อมยกระดับ AI ให้เป็นส่วนหนึ่งของโครงสร้างพื้นฐานเชิงยุทธศาสตร์ขององค์กร

- Secure AI Pipelines: ปกป้อง Data Inputs, Model Weights และ Inference Endpoints ด้วยมาตรฐานความปลอดภัยเดียวกับที่ใช้ในการคุ้มครองซอร์สโค้ดหรือกุญแจเข้ารหัส

- Invest in Threat Intelligence with AI: นำ AI มาใช้ในการวิเคราะห์รูปแบบภัยคุกคาม ตรวจจับความผิดปกติ และจัดลำดับความเสี่ยงอย่างทันท่วงที ขณะที่มนุษย์ยังคงทำหน้าที่กำกับและตรวจสอบในทุกกระบวนการสำคัญ

- Build Resilience: ให้ความสำคัญกับการจำกัดขอบเขตความเสียหาย ความต่อเนื่องของธุรกิจ และการฟื้นฟูระบบ ภายใต้สมมติฐานว่า AI-driven Attacks สามารถเจาะผ่านมาตรการป้องกันขององค์กรได้ตลอดเวลา

- Upskill Security Teams: ยกระดับขีดความสามารถของทีมรักษาความปลอดภัยโดยการพัฒนาทักษะเฉพาะด้าน AI และ ML การตรวจสอบโมเดล และการตรวจจับภัยคุกคามที่ขับเคลื่อนด้วย AI เพื่อปิดช่องว่างเชิงความเชี่ยวชาญที่มีอยู่

Three Strategic Pillars of AI-powered Cyber Defense

สามเสาหลักของการป้องกันภัยไซเบอร์ในยุคที่ AI เป็นศูนย์กลาง

การป้องกันภัยไซเบอร์ในยุค AI จะมีประสิทธิผลได้ก็ต่อเมื่อองค์กรสามารถยกระดับและเชื่อมโยงสามแกนสำคัญ—บุคลากร กระบวนการ และเทคโนโลยี—เข้าด้วยกันอย่างสมดุลและเป็นระบบ เสาหลักทั้งสามนี้คือรากฐานที่ช่วยให้องค์กรรับมือภัยยุคใหม่ได้อย่างต่อเนื่อง มีความยืดหยุ่น และยั่งยืน

1. มนุษย์: Human judgment remains the last line of defense

แม้เทคโนโลยีจะก้าวหน้าเพียงใด แต่มนุษย์ยังคงเป็นแกนหลักของความมั่นคงปลอดภัยไซเบอร์ในยุค AI ในฐานะผู้กำกับดูแลและตัดสินใจในขั้นตอนสำคัญ เพื่อให้กระบวนการป้องกันทั้งหมดทำงานได้อย่างถูกต้องและปลอดภัยที่สุด ช่องว่างความรู้ด้าน AI Security จึงกลายเป็นความเสี่ยงเชิงระบบที่ส่งผลต่อขีดความสามารถขององค์กรในการประเมิน ควบคุม และตอบสนองต่อภัยคุกคามรูปแบบใหม่อย่างมีประสิทธิภาพ

Key Actions

- จัดโปรแกรม Upskill เฉพาะทางด้าน AI Security

- จัดตั้งหน่วยงานเฉพาะทาง เช่น AI Security Taskforce

- ส่งเสริมวัฒนธรรม Security by Design ในทุกทีมและทุกโครงการ

2. กระบวนการ: Governance is the new perimeter

ความตื่นตัวต่อภัยคุกคามไซเบอร์ในยุค AI กำลังผลักดันให้ “การกำกับดูแล (Governance)” เป็นอีกหนึ่งมาตรฐานสำคัญของการป้องกันภัยไซเบอร์ยุคใหม่ องค์กรจำเป็นต้องประเมินและระบุความเสี่ยงของระบบ AI ในทุกกระบวนการ—ตั้งแต่การเตรียมข้อมูล การพัฒนาโมเดล ไปจนถึงการตอบสนองต่อเหตุการณ์—โดยมีกรอบการกำกับดูแลที่ชัดเจน ตรวจสอบได้ และสอดคล้องกันทั่วทั้งองค์กร

การสร้าง Cyber Resilience ต้องตั้งอยู่บนสมมติฐานว่า “ระบบอาจถูกเจาะได้เสมอ” (Assume Breach) องค์กรจึงต้องเตรียมความพร้อมทั้งด้านความต่อเนื่องของธุรกิจ (Business Continuity) และกระบวนการฟื้นฟูระบบ (Recovery) เพื่อจำกัดวงความเสียหายและลดผลกระทบให้เหลือน้อยที่สุด

Key Actions

- พัฒนา AI Governance Framework ที่บูรณาการ Data, Model และ Operation

- จัดทำและทดสอบ Response & Recovery Playbook อย่างสม่ำเสมอ

- ผสานการประเมินความเสี่ยง AI ในทุกช่วงของวงจรชีวิตโมเดล

3. เทคโนโลยี(Technology) — Defense at Machine Speed

ปัจจุบัน AI ทำหน้าที่เป็นทั้ง อาวุธ (Sword) และ เกราะป้องกัน (Shield) องค์กรจึงต้องยกระดับขีดความสามารถด้านการป้องกันไซเบอร์ให้รองรับภัยคุกคามที่ใช้ AI เป็นเครื่องมือโจมตี ระบบการป้องกันยุคใหม่จำเป็นต้องมีทั้ง การป้องกันเชิงรับ (Defensive AI) ที่ตรวจจับสัญญาณผิดปกติได้อย่างรวดเร็วและแม่นยำ และ การป้องกันเชิงรุก เพื่อค้นหาช่องโหว่และจุดอ่อนของโมเดลก่อนที่ผู้ไม่ประสงค์ดีจะพบเจอ

Key Actions

- ลงทุนในแพลตฟอร์มป้องกันภัยไซเบอร์ที่รองรับการวิเคราะห์และตอบสนองแบบอัตโนมัติ

- ผสานความสามารถของระบบอัตโนมัติ การวิเคราะห์เชิงลึก และการกำกับดูแลของมนุษย์

- ดำเนินกระบวนการทดสอบเชิงรุกอย่างสม่ำเสมอ เช่น Red Teaming และ Model Stress Testing เพื่อค้นหาจุดอ่อนล่วงหน้า

โลกกำลังก้าวสู่ยุคที่ AI เป็นทั้งปัจจัยเร่งการเติบโตของธุรกิจและเป็นความเสี่ยงด้านความมั่นคงปลอดภัยไซเบอร์ องค์กรที่พร้อมที่สุดจึงไม่ใช่องค์กรที่มีเทคโนโลยีล้ำหน้าเพียงอย่างเดียว แต่คือผู้ที่ “เข้าใจความเสี่ยงก่อน ปรับตัวได้เร็ว และเชื่อมโยงการทำงานของบุคลากร–กระบวนการ–เทคโนโลยีเข้าด้วยกันอย่างมีกลยุทธ์” ภายใต้มาตรฐานความปลอดภัยไซเบอร์ยุคใหม่ ที่ครอบคลุมตั้งแต่การป้องกันและการตอบสนองต่อเหตุการณ์ ไปจนถึงการจำกัดขอบเขตความเสียหาย การรักษาความต่อเนื่องของธุรกิจ และการฟื้นตัวอย่างรวดเร็ว เพื่อรักษาความน่าเชื่อถือและสนับสนุนการเติบโตอย่างยั่งยืน